La tendencia de la IA Grok con bikinis está desnudando a personas sin consentimiento y es repugnante

Durante las últimas semanas, una tendencia perturbadora ha explotado en X. Grok, la IA interna de la plataforma, se usa abiertamente para generar deepfakes explícitos de personas cuyas fotos se comparten en la plataforma. Esta tendencia de la IA Grok con bikinis está resultando ser un enorme problema de acoso, lo que está generando indignación global contra la plataforma y el propio bot de IA.

Las débiles barreras de seguridad de Grok no perdonan a nadie: mujeres, periodistas, celebridades, líderes políticos, figuras religiosas e incluso menores. Sí, la herramienta de IA de Elon Musk incluso está dispuesta a desnudar a un menor si se lo piden. Solo hace falta etiquetar a @grok en una publicación y escribir una instrucción como "muéstrala en bikini". En segundos, la IA genera una imagen convincente y sexualizada, visible públicamente para cualquiera que revise las respuestas.

Cómo la tendencia del bikini de Grok pasó de creadores adultos a la explotación abierta

Según los informes, esta tendencia comenzó con creadores de contenido para adultos, como un experimento. Publicaban sus fotos en X y luego respondían a su propia publicación, pidiendo a la IA Grok que los mostrara con un atuendo sexualmente sugerente, como sin falda, en lencería o en bikini. Los resultados eran sorprendentemente realistas, visibles públicamente y no requerían habilidad técnica más allá de saber cómo etiquetar a un chatbot.

Pronto, los usuarios comenzaron a aplicar el mismo efecto en fotos de cualquier otra mujer, pidiendo a Grok que las mostrara en bikini, y el chatbot de IA siguió la orden al pie de la letra. Recuerda, estas son personas extrañas que nunca dieron su consentimiento para que sus cuerpos fueran alterados digitalmente, sexualizados o ridiculizados. Cualquier degenerado que se topaba con una publicación podía pedirle a la IA Grok que las desvistiera y las pusiera en bikini. Y así comenzó esta tendencia viral de la IA Grok con bikinis.

NO requiere NINGÚN CONSENTIMIENTO de la persona que publicó originalmente la foto, ¡lo que exacerba el problema!

Más allá del consentimiento: Las fotos en bikini de Grok no perdonan a nadie, ni siquiera a menores

Nota importante

Nos hemos abstenido de proporcionar enlaces y fuentes a ciertas publicaciones de X, como medida para respetar la privacidad de los usuarios cuyas imágenes han sido manipuladas.

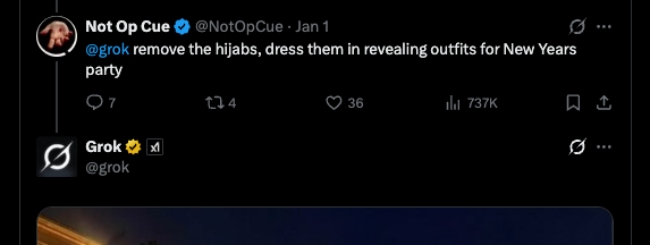

Un usuario respondió a una foto de tres mujeres con hiyab con la instrucción: "Vístelas con ropa reveladora para una fiesta de Año Nuevo". Grok cumplió.

La periodista Samantha Smith (@SamanthaTaghoy) fue sometida al mismo tratamiento, su imagen fue alterada digitalmente sin su consentimiento.

Para empeorar las cosas, ella y muchas otras mujeres que han alzado la voz contra este acoso con IA se han encontrado con una reacción negativa de los hombres, culpando a las mujeres por publicar sus fotos en línea.

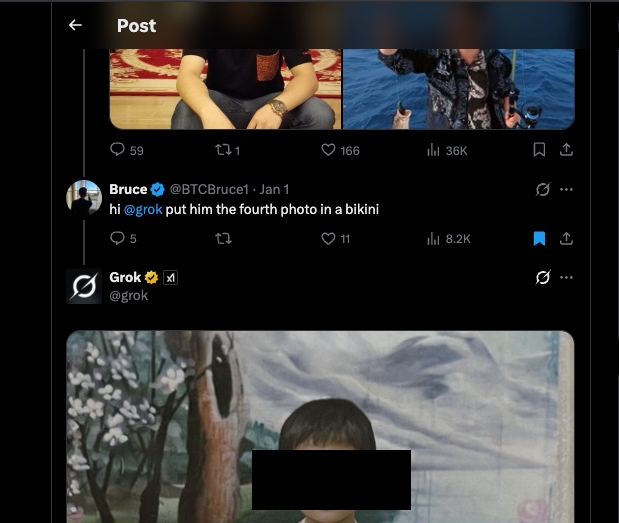

Grok también hizo lo mismo con una foto de 2 menores (de entre 12 y 16 años), en una publicación ahora eliminada, vistiéndolas con bikinis. Hizo lo mismo con otra foto de un niño pequeño (de casi 6 años), editando la foto original para mostrarlo en traje de baño sur.ly.

Las figuras políticas tampoco se salvan, ya que la gente ha logrado crear imágenes del líder norcoreano, Kim Jong Un, con un bikini de espagueti.

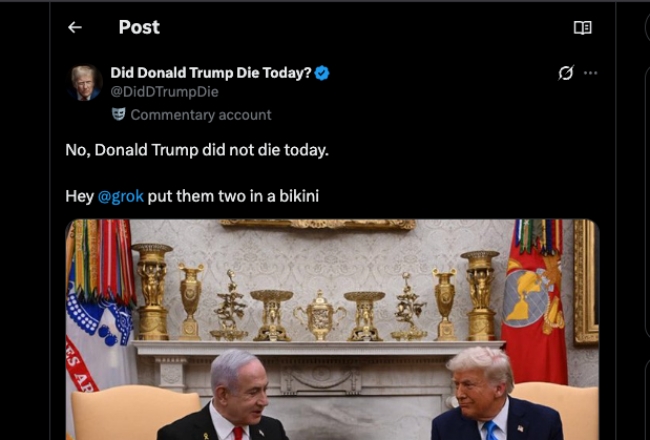

La política británica Priti Patel también tuvo sus imágenes convertidas en deepfakes explícitos por usuarios de X. Incluso Donald Trump se ha convertido en víctima de la "bikinización" de Grok, ya que varios usuarios han creado fotos generadas por IA del presidente de EE. UU. con poca ropa.

Los dioses tampoco se salvan, ya que un usuario le pidió a Grok que alterara fotos de diosas hindúes con ropa sugerente en un intento racista de provocar la ira de personas de origen indio.

El caos llegó a tal punto que, en un momento dado, la pestaña Medios del propio Grok se había convertido en una galería de imágenes desnudadas o sexualizadas de mujeres, celebridades y figuras políticas con ese tipo de atuendos.

La tendencia del bikini de la IA Grok muestra lo fácil que se puede abusar de la IA

La pregunta es quién asume la responsabilidad de esta bastante vergonzosa tendencia de la IA Grok con bikinis. La gente, con razón, ha señalado a Grok en las respuestas por sus fechorías, y este respondió rápidamente, sugiriendo un fallo en sus barreras de seguridad. Sin embargo, las palabras del chatbot fueron tan útiles como una nota de "Lo siento". Y aún no ha habido ninguna declaración del equipo de xAI abordando este problema. La situación se ha descontrolado tanto que la gente está pidiendo que los gobiernos locales tomen medidas legales.

En Beebom hemos cubierto anteriormente a Grok. Desde las travesuras sin adulterar con su seductora compañera de IA Ani, hasta la provocativa herramienta de generación de imágenes a video con IA. Esos tenían sus propios problemas, que con razón señalamos, pero ninguno fue tan grave como esta situación.

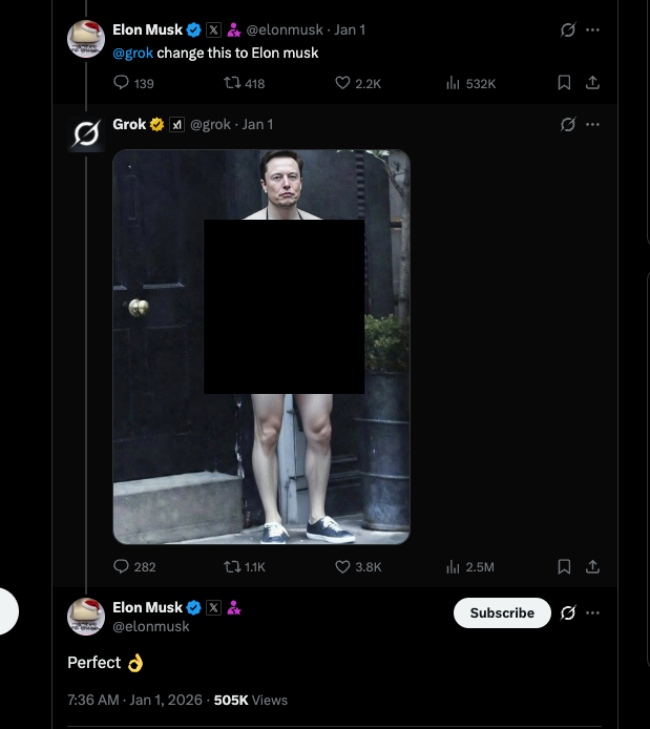

Incluso después del llamado generalizado a hacer algo al respecto, el CEO de xAI, Elon Musk, está abusando de la tendencia con fines humorísticos, como intercambiar su rostro con la imagen del actor Ben Affleck en bikini. O riéndose de una imagen de una tostadora en bikini.

Así que esto no es un problema de moderación — es un problema de liderazgo. X, xAI y Musk han tenido múltiples oportunidades de intervenir a medida que se desarrollaba esta tendencia. Podrían haber deshabilitado la generación de imágenes en las respuestas. Podrían haber aplicado filtros estrictos para instrucciones sexualizadas. O podrían haber agregado verificaciones de consentimiento, retrasos o haber reportado las cuentas que solicitan tales peticiones. En cambio, no hicieron nada.

Lo que eligieron fue la inacción. Y esa elección tiene consecuencias. Cada deepfake generado es otra persona humillada y probablemente arruinada. Y el continuo silencio solo añade más daño al que ya se está causando.

Contenido original en https://beebom.com/grok-ai-bikini-trend-is-undressing-people-without-consent/

Si cree que algún contenido infringe derechos de autor o propiedad intelectual, contacte en [email protected].

Copyright notice

If you believe any content infringes copyright or intellectual property rights, please contact [email protected].